Introducción

Esta guía demuestra cómo desplegar DeepSeek en máquinas virtuales de Azure aprovechando el modelo de pago por uso. El autor explica «cómo desplegar DeepSeek en una máquina virtual dentro de Azure, aprovechando el modelo de pago por uso».

Este enfoque permite ejecutar el modelo de IA de código abierto DeepSeek-R1 en tu propio entorno de Azure, manteniendo control total sobre los datos y la infraestructura mientras pagas solo por los recursos que utilizas.

Configuración de la Infraestructura

Las especificaciones recomendadas incluyen:

- Tipo de VM: Standard D8s v3 (8 vCPUs, 32 GiB RAM)

- Sistema Operativo: Ubuntu Pro 24.04 LTS

El autor señala que esta configuración soporta la variante del modelo DeepSeek de 7B (7 mil millones de parámetros).

Preparación de la VM

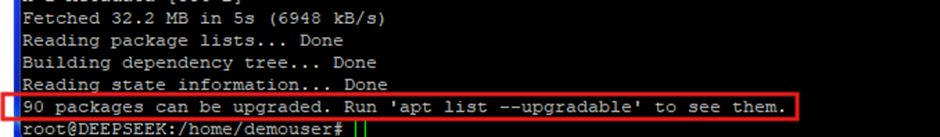

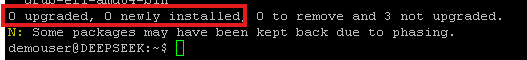

La preparación inicial del sistema requiere dos comandos:

sudo apt update

sudo apt upgrade

Importante: Se recomienda un reinicio después de la actualización para asegurar que todos los cambios del sistema se apliquen correctamente.

Instalación del Modelo

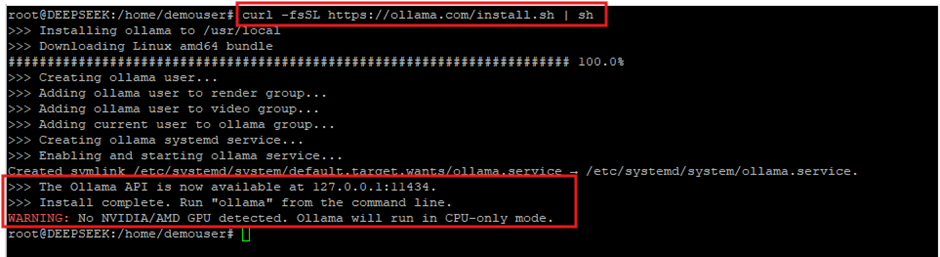

Paso 1: Descargar Ollama

La instalación utiliza un script de shell de la descarga oficial de Ollama para Linux. El comando es:

curl -fsSL https://ollama.com/install.sh | sh

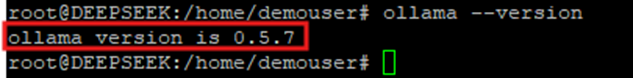

Paso 2: Confirmar la Instalación

Verifica que Ollama se haya instalado correctamente:

ollama –version

Paso 3: Obtener el Modelo

Descarga el modelo DeepSeek-R1:

ollama pull deepseek-r1

Nota: Este proceso puede tardar varios minutos dependiendo de tu conexión a internet, ya que el modelo tiene varios gigabytes de tamaño.

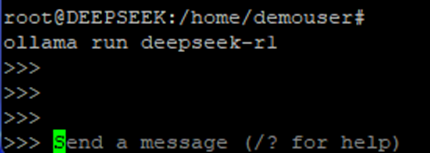

Paso 4: Ejecutar el Modelo

Inicia el modelo DeepSeek-R1 en modo interactivo:

ollama run deepseek-r1

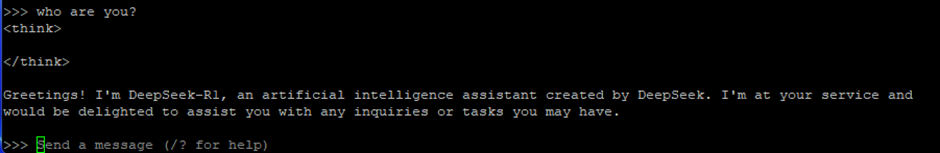

Pruebas y Conclusión

El autor demuestra las pruebas consultando al modelo con «Who are you?» para verificar la funcionalidad local:

Para salir de la consola interactiva, utiliza Ctrl+D.

La guía concluye: «Ahora ya sabes cómo desplegar DeepSeek-R1 en una máquina virtual en Azure… puedes empezar a hacer preguntas y obtener respuestas directamente en tu entorno local.»

Ventajas de Este Enfoque

- Control Total de Datos: Todos los datos permanecen en tu entorno de Azure

- Pago Por Uso: Solo pagas por los recursos que realmente utilizas

- Ejecución Local: El modelo se ejecuta completamente en tu VM sin enviar datos a terceros

- Escalabilidad: Puedes ajustar el tamaño de la VM según tus necesidades

- Flexibilidad: Libertad para experimentar con diferentes configuraciones y modelos

Consideraciones Importantes

Requisitos de Hardware: El modelo DeepSeek-R1 de 7B requiere al menos 8 GB de RAM. Para modelos más grandes, necesitarás VMs con más recursos.

Costes: Aunque el modelo es gratuito, pagarás por el tiempo de ejecución de la VM en Azure. Asegúrate de apagar la VM cuando no la estés utilizando para minimizar costes.

Seguridad: Configura grupos de seguridad de red (NSG) apropiados y considera usar Azure Bastion para acceso seguro a la VM.

Rendimiento: Sin GPU, el rendimiento será limitado. Para casos de uso intensivos, considera VMs con GPU de la serie NC o ND.

¡Y listo! Ahora ya sabes cómo implementar DeepSeek-R1 en una máquina virtual de Azure. Desde la configuración de la infraestructura hasta la puesta en marcha del modelo, hemos cubierto todos los pasos importantes. Con Ollama instalado y DeepSeek-R1 listo para usar, puedes empezar a hacer preguntas y obtener respuestas directamente en tu entorno local. ¡Es increíble lo que puedes lograr con un poco de configuración y las herramientas adecuadas! Si alguna vez necesitas salir de la consola, simplemente presiona Ctrl+D y listo. ¡Que disfrutes explorando DeepSeek!